A raíz de nuestro artículo sobre los repositorios de Ubuntu, el lector Carlos nos pregunta sobre como trabajar con ellos. Quiero aclarar que aunque la mayoría de los tutoriales explican como hacerlo usando la terminal, esto es porque resulta mucho más cómodo para quienes los escribimos. Se puede trabajar de maravillas con ellos usando una herramienta gráfica.

Cómo trabajar con repositorios. La herramienta Software y actualizaciones

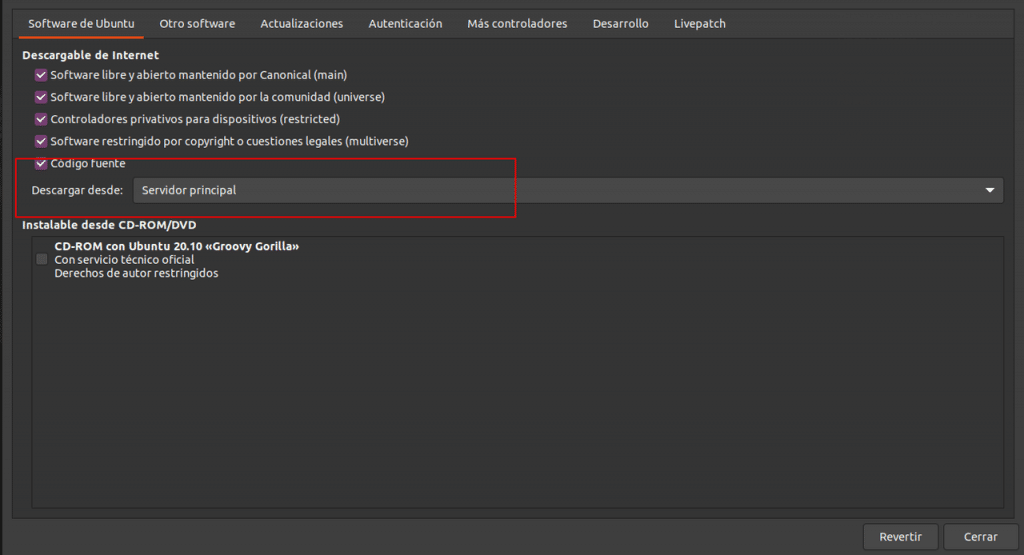

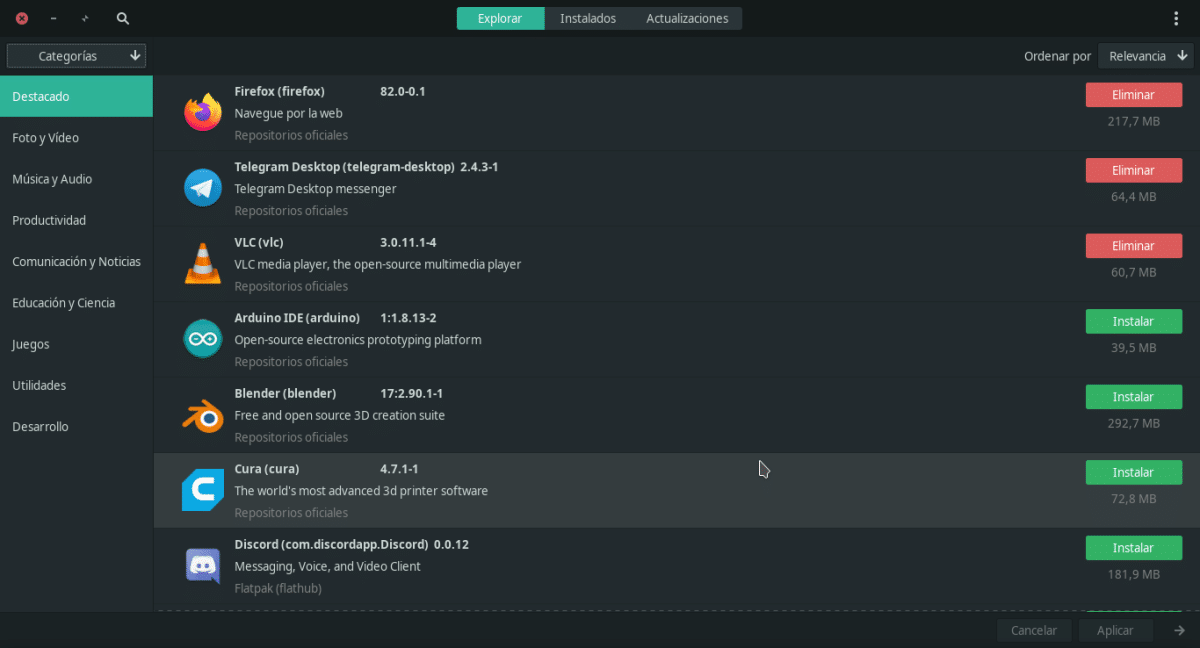

Nuestro primer paso para trabajar con los repositorios es abrir la herramienta que se encarga de gestionarlos. Esa herramienta se llama Software y actualizaciones y puedes encontrarla escribiendo cualquiera de las dos palabras en el lanzador. Una vez que lo hacemos veremos algo como esto.

Presta atención al sector de la captura de pantalla recuadrado. Dependiendo de la opción que elijas esto determinará la rapidez con que se descargan e instalan los programas y actualizaciones en tu equipo.

Puedes optar por tres opciones

- El servidor que Ubuntu destina para las descargas de tu país (es la opción que viene activada por defecto)

- Un servidor cercano a tu ubicación geográfica cedido por un tercero para la descarga de Ubuntu (Permite descargas más rápidas.

- El servidor principal de Ubuntu (Tendrás las actualizaciones disponibles antes que usando los otros servidores pero la descarga puede tardar un poco más)

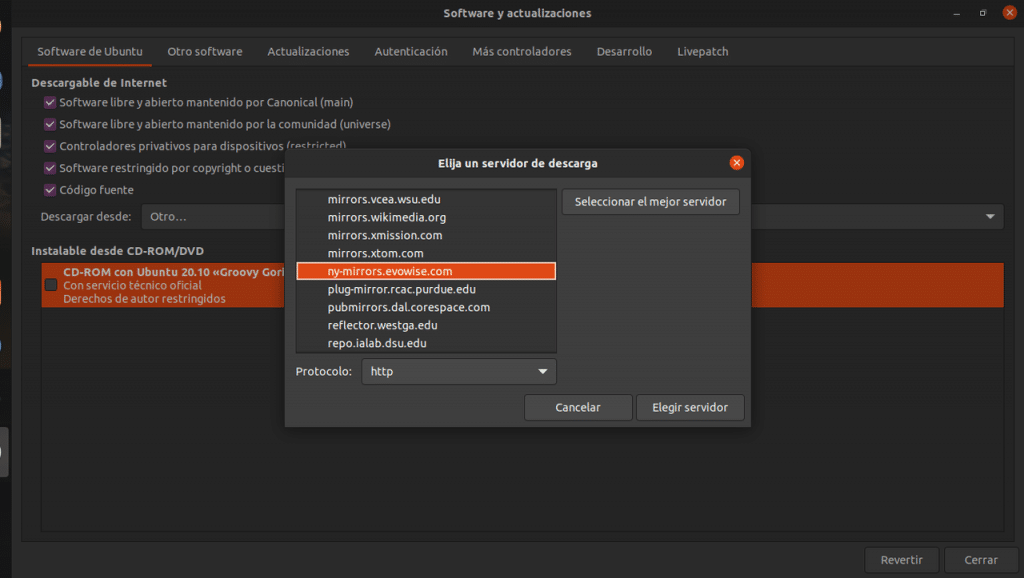

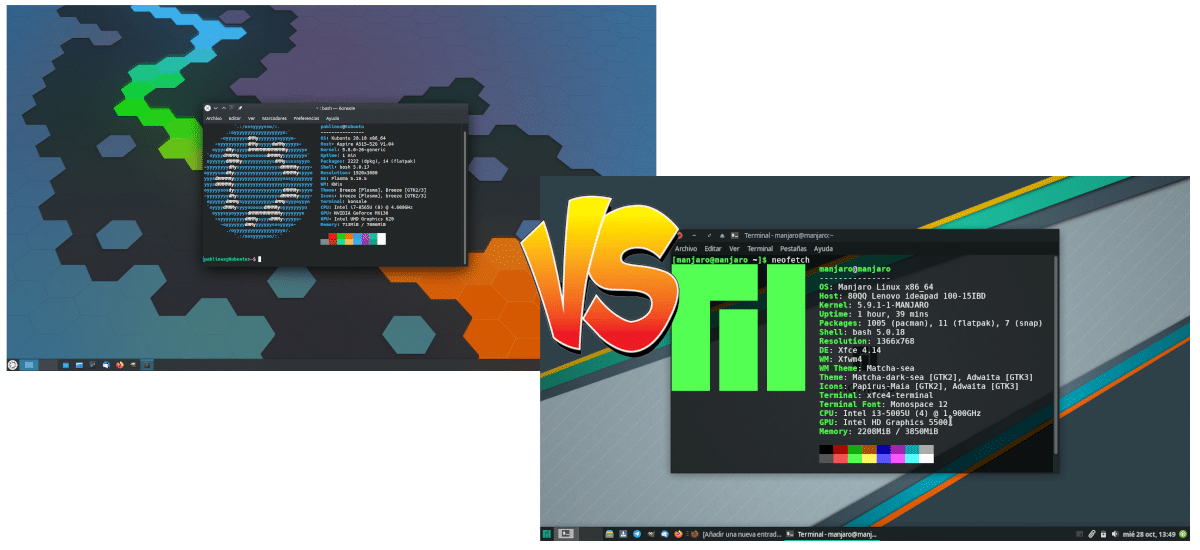

Seleccionando un servidor de descarga

Cuando pulses sobre la derecha del sector recuadrado, verás un menú con 3 opciones. Si quieres seleccionar el servidor con descargas más rápidas, solo tienes que pulsar en la palabra Otro.

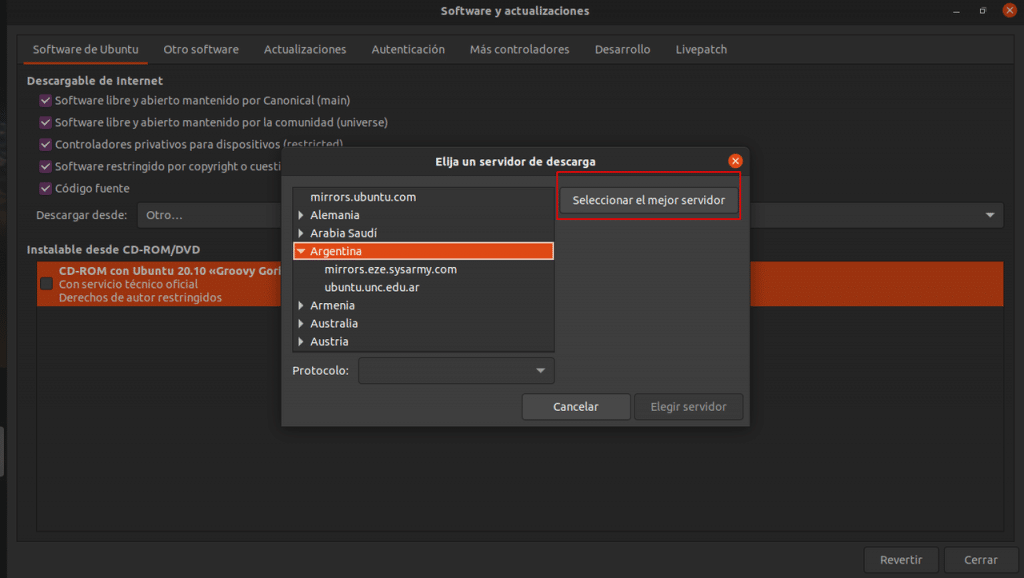

Ubuntu nos permite seleccionar el servidor de descargas más rápido según nuestra ubicación geográfica

La ventana inicial nos muestra los servidores correspondientes a nuestros país, pero no siempre suelen ser los más rápidos. Esto puedes comprobarlo pulsando en Seleccionar el mejor servidor.

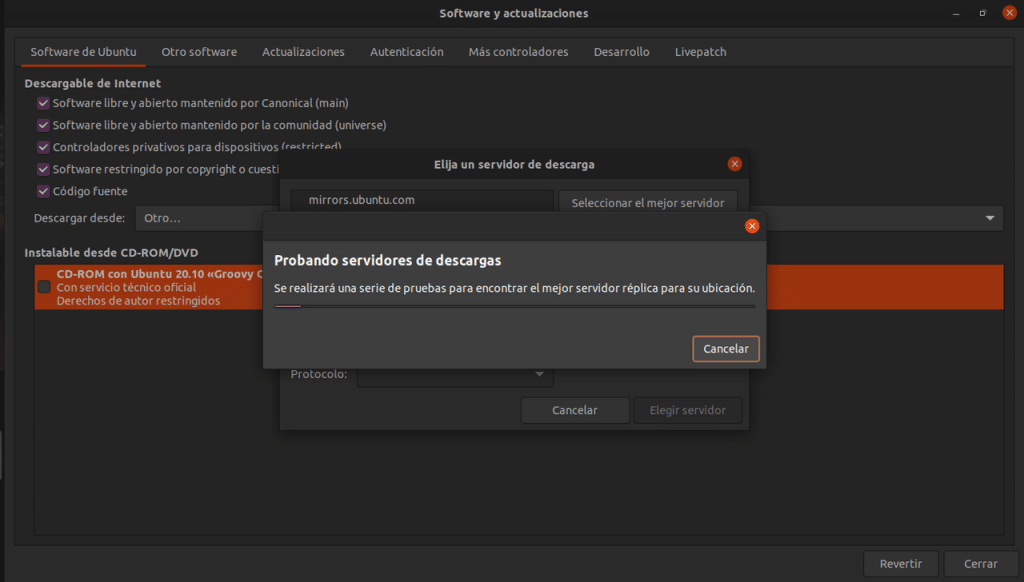

Ubuntu realiza rápidamente pruebas a los distintos servidores de su lista para encontrar el mejor según nuestra ubicación.

El proceso de prueba dura unos pocos minutos tras lo cuál nos ofrece su sugerencia.

Es buen momento para aclararte que para que cualquier cambio que hagas con la herramienta Software y actualizaciones tenga efecto, debes pulsar el botón Cerrar y permitir que la lista de repositorios se actualice.

Descarga de código fuente y desde medio de instalación

Antes de pasar al tema sobre cómo trabajar con repositorios de terceros, debemos dedicar nuestra atención a dos cosas más de la pantalla inicial.

Si observas los rubros listados bajo el título Descargable de Internet verás una lista de repositorios. Cuatro son los que comentamos en un artículo anterior, pero del quinto, Código fuente, no habíamos dicho nada hasta ahora.

Anteriormente dijimos que Ubuntu utiliza dos formatos de programas principales. DEB y Snap. Aunque ambos se instalan, se manejan y funcionan de manera diferente, el Centro de software de Ubuntu puede trabajar indistintamente con cualquiera de los dos.

Por el contrario, la herramienta Software y actualizaciones trabaja únicamente con repositorios de paquetes DEB y, en caso de activar la opción con código fuente. En este último caso estamos hablando de programas que los desarrolladores de Ubuntu no llegaron a convertir al formato de paquetes DEB y deben ser compilados en nuestra computadora para poder utilizarse. La compilación es el proceso de convertir un programa escrito en un lenguaje de programación amigable para los seres humanos en otro legible para la computadora.

Activar esta opción no es obligatorio y puede hacer un poco más lento el proceso de instalación. Sin embargo, si por algún motivo necesitas la última versión de un programa o simplemente no soportas la espera, puedes marcarla. Tampoco es que afecte demasiado.

La última opción que quería comentarte antes de abandonar la primera pantalla del Centro de Software es la de instalar programas desde el medio de instalación. Nunca se molestaron en cambiar el título por lo que sigue hablando de CD-ROM, pero, lo mismo vale para medios de instalación en pendrive. En caso de marcar el recuadro, los programas se instalarán desde ahí en lugar de buscarlos en un servidor de Internet. Por supuesto, no tendrás actualizaciones hasta que no lo desmarques.

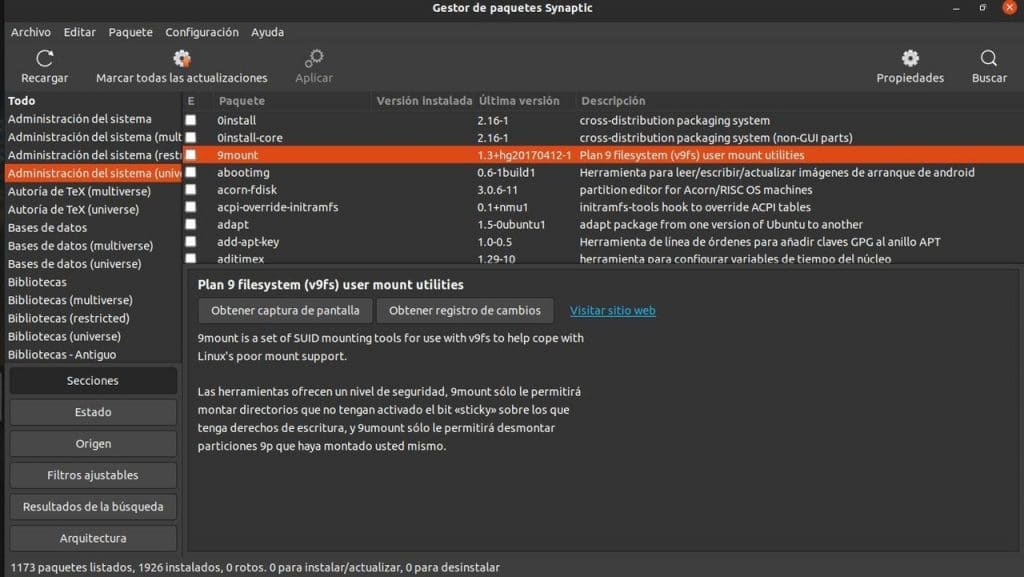

En el próximo artículo veremos como activar repositorios de terceros de manera gráfica

from Linux Adictos https://ift.tt/2JrZFXl

via IFTTT