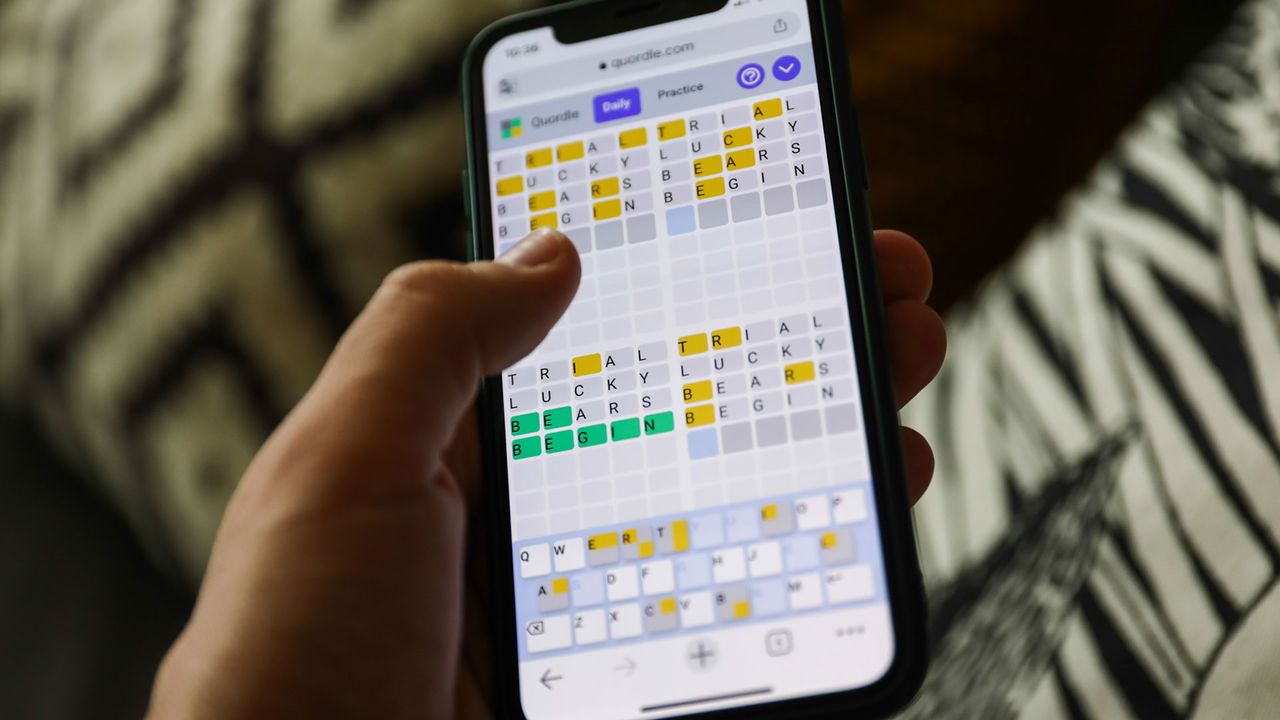

¿Buscas pistas de Quordle y respuestas para hoy o para soluciones anteriores? En este artículo te mostramos un enfoque estratégico para optimizar tu experiencia con Quordle, aprovechando recursos confiables y técnicas probadas.

Introducción

Quordle es un juego de palabras que desafía la rapidez y la habilidad de deducción. Aunque cada partida es única, hay patrones y métodos que pueden ayudarte a identificar pistas eficientemente y acercarte a la solución con mayor precisión. A continuación, encontrarás recomendaciones prácticas para navegar entre pistas actuales y soluciones históricas, sin depender de atajos inseguros.

Cómo obtener pistas y respuestas actuales

– Observa la distribución de letras: analiza rápidamente qué letras han sido confirmadas, descartadas o permanecen en duda. Esto reduce el rango de posibles palabras y acelera el proceso de conjetura.

– Prioriza palabras iniciales que cubran consonantes y vocales comunes: empezar con combinaciones equilibradas aumenta la probabilidad de revelar letras clave en las primeras rondas.

– Registra tus hallazgos: mantener un registro breve de las letras confirmadas y descartadas facilita las conjeturas subsecuentes y evita repeticiones.

– Evita cegarte con una única solución provisional: si una opción no cuadra con las tres cuadrículas, reevalúa y prueba otras combinaciones posibles.

Acceder a soluciones actuales y pasadas

– Consulta recursos reputados que publiquen soluciones diarias de Quordle. Estos sitios suelen aportar explicaciones sobre por qué ciertas palabras funcionaron en ese día concreto, lo que puede ayudarte a entender patrones y estrategias a largo plazo.

– Revisa recopilaciones de soluciones pasadas para identificar tendencias: palabras que tienden a aparecer en días consecutivos o en combinaciones similares pueden ofrecer indicios útiles para futuras partidas.

– Mantén una mentalidad crítica: la popularidad de ciertas soluciones pasadas no garantiza un rendimiento similar en el futuro; el objetivo es comprender enfoques y no buscar respuestas automáticas.

Estrategias para mejorar tu rendimiento

– Practica con regularidad: la familiaridad con estructuras de palabras comunes mejora la velocidad de reconocimiento y reducción de opciones.

– Amplía tu vocabulario: conocer variaciones y prefijos/sufijos frecuentes te da más herramientas para formular conjeturas efectivas.

– Analiza errores sin frustrarte: cada intento fallido es una oportunidad de aprender qué patrones no funcionan para ese día.

– Mantén la calma: la presión puede afectar la toma de decisiones; toma pausas cortas para recargar la concentración durante las sesiones largas.

Conclusión

Encontrar pistas de Quordle y acceder a soluciones actuales y pasadas puede enriquecer tu experiencia de juego cuando se aborda con método y prudencia. Al combinar observación analítica, registro de datos y revisión de soluciones históricas, puedes mejorar de forma constante tu rendimiento sin perder la diversión del desafío lingüístico que ofrece Quordle.

Nota final

Este artículo se centra en estrategias de juego y análisis para optimizar tu desempeño. No se proporcionarán soluciones específicas a juegos individuales dentro del texto.

from Latest from TechRadar https://ift.tt/VjXxrZw

via IFTTT IA