(adsbygoogle = window.adsbygoogle || []).push({});

Hace muchos años que me muevo más cómodo en Linux que en Windows; a macOS le doy de comer aparte, no porque lo odie, sino porque ahora mismo no veo necesario pagar todo lo que piden por un Mac. Pero lo cierto es que a veces necesito algo de Windows, o no es una necesidad, sino algo que quiero hacer en el sistema de Microsoft, como probar que una aplicación propia funciona en Windows. Hasta el 10 todo era más sencillo, e instalarlo en una máquina virtual no tenía mucho misterio, pero todo cambió cuando lanzaron Windows 11.

La 11ª versión del sistema de las ventanas pide unos requisitos que dificultan bastante las cosas, hasta el punto de que hay que cambiar todo un equipo porque en algunos no se puede actualizar. Parte de la culpa la tienen el TPM y el Secure Boot, dos comprobaciones que hace Windows 11 durante un proceso de instalación que no avanza si no tenemos un equipo compatible. Esto también pasa en las máquinas virtuales, pero aquí os vamos a enseñar como hacerles un «by pass» a esas comprobaciones para instalar Windows 11 en una máquina virtual que se ejecute en Linux.

(adsbygoogle = window.adsbygoogle || []).push({});

Windows 11 en una máquina virtual

El secreto está en las palabras «by pass» o en puentear lo que nos nos impide instalar Windows 11 como lo haríamos con Windows 10 o anteriores. Los pasos a seguir quedarían así?

- Conseguimos una imagen ISO de Windows 11. Se puede conseguir una legal desde este enlace.

- Iniciamos GNOME Boxes o VirtualBox. Los pasos importantes para permitir la instalación son los mismos en ambos casos.

- Iniciamos la creación de la máquina virtual. En GNOME Boxes le deja por defecto 128GB de almacenamiento, y no debería ser necesario tanto. El mínimo de RAM debería ser de 8GB, pero eso también se puede puentear. En este punto le dejamos lo que creamos que irá bien, y eso también depende del hardware de nuestro equipo. Yo, con 1TB de almacenamiento y 32GB de RAM, le he dejado esos 128GB de disco duro (que va ocupando si se va llenando) y 12GB de RAM.

- En la pantalla en la que nos dice de iniciar la instalación, presionamos Mayúscula+(Fn)F10, lo que nos abrirá el símbolo del sistema.

- Escribimos «regedit» sin las comillas, lo que nos abrirá el editor del registro.

- Esto es lo importante. Tenemos que crear una carpeta y 3 entradas.

- Vamos a HKEY_LOCAL_MACHINE/System/Setup, hacemos clic secundario sobre esa carpeta y creamos una clave (carpeta) con el nombre Labconfig.

- Hacemos clic sobre esa carpeta.

- A la derecha, hacemos clic derecho/Nuevo/Valor de DWORD (32bits) con nombre BypassTPMCheck. Luego hacemos clic derecho sobre ese valor, seleccionamos modificar y le damos un valor de 1.

- Repetimos el paso 3 dos veces más, pero una con BypassRAMCheck y otra con BypassSecureBootCheck.

- Ahora sí, iniciamos la instalación y seguimos las instrucciones que aparecen en pantalla como siempre hemos hecho.

Pasos adicionales en VirtualBox

Si hemos instalado Windows 11 en VirtualBox, que es mejor opción que GNOME Boxes para algunos, pero también requiere más instalaciones y más pasos, al iniciar cualquier sistema operativo lo hace en una ventana muy pequeña, pero eso tiene solución instalando las Guest Additions. Y para acceder a todo el hardware, como los puertos USB o la cámara web, hace falta instalar el Extensiion Pack. Eso está explicado mejor en este enlace.

Instalando Tiny11

Si esos 128GB de almacenamiento, 12GB de RAM y lo del TPM os dan algo de respeto, hay otra opción. Se llama Tiny11, y es un Windows 11 que ha creado un desarrollador básicamente quitándole software y preparándolo para que funcione en equipos más discretos. Está disponible en Internet Archive, pero su desarrollador lo va mejorando con el paso del tiempo. La última versión ya está basada en Windows 11 Pro 22H2 y promete funcionar en tan sólo 8GB de almacenamiento. Tiene un precio, y es que por defecto ni siquiera tiene instalado Microsoft Edge, pero se puede arreglar instalando Firefox desde la Microsoft Store.

(adsbygoogle = window.adsbygoogle || []).push({});

Tiny11 tiene desactivadas las comprobaciones de Windows 11, por lo que no nos pedirá ni ciertos requisitos mínimos ni comprobará que nuestro equipo soporte TPM 2.0.

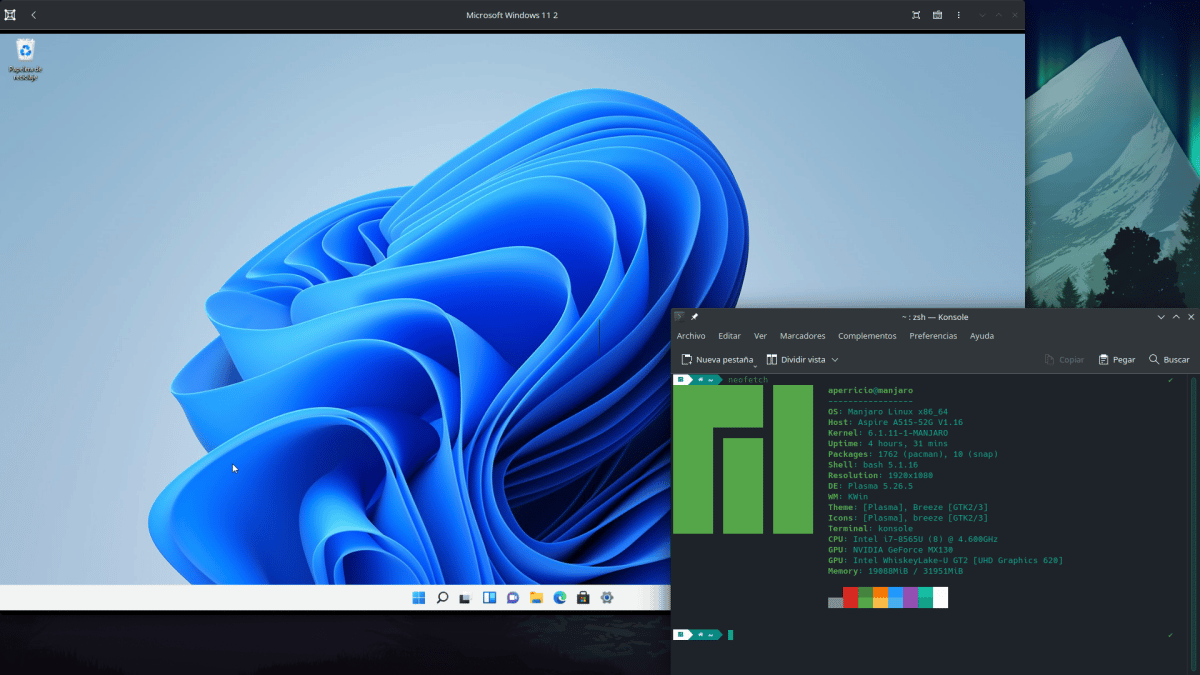

Se elija lo que se elija, en mis pruebas he podido comprobar que Windows 11 se comporta mejor que Windows 10, por lo menos en GNOME Boxes. Y si necesito hacer alguna prueba en Windows, haciendo lo explicado aquí no necesito salir de mi Linux favorito.

from Linux Adictos https://ift.tt/oqh6Oui

via IFTTT