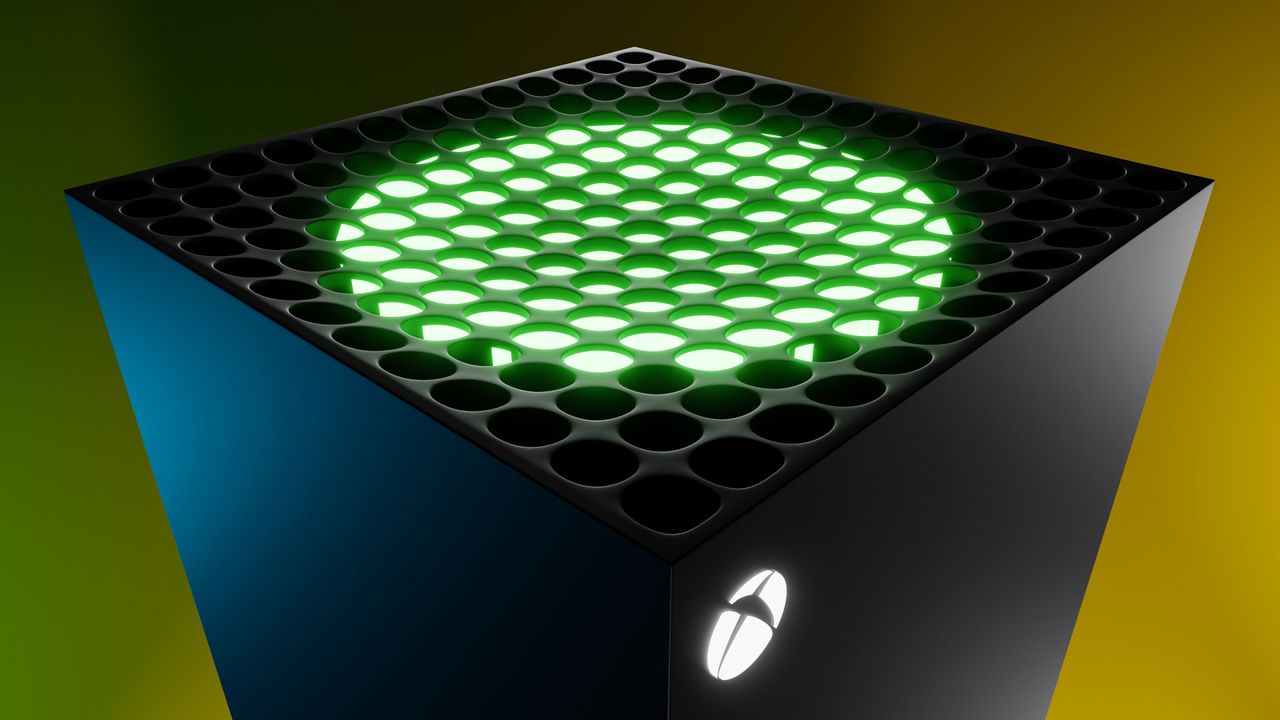

Microsoft ha reafirmado su compromiso con el Programa de Compatibilidad Descendente de Xbox para sus consolas futuras y ha confirmado que regresará en alguna forma a lo largo de este año. Esta noticia plantea varias implicaciones estratégicas y estéticas para la industria de los videojuegos, así como para los jugadores que buscan conservar su colección de títulos a lo largo de varias generaciones.

En primer lugar, la compatibilidad descendente no es solo una función técnica; es una promesa de continuidad. Permite a los usuarios mantener acceso a bibliotecas de juegos que han sido adquiridos en generaciones anteriores, reduciendo la fricción de transición entre consolas y fomentando una experiencia más sostenible. En un ecosistema donde las innovaciones gráficas y de rendimiento tienden a acaparar la atención, la compatibilidad se convierte en un puente que conecta lo clásico con lo moderno, manteniendo vivo el legado de títulos que definieron épocas.

La confirmación de que el programa volverá, aunque sea en una forma distinta, sugiere un enfoque más flexible y adecuado a las necesidades de la base de usuarios. Es probable queMicrosoft explore modelos que integren mejor la experiencia de juego entre generaciones, optimicen el rendimiento a través de actualizaciones de software y ofrezcan opciones de preservación que simplifiquen la transición para usuarios con bibliotecas extensas.

Para los desarrolladores y editores, este movimiento representa una oportunidad para ampliar la vida útil de sus juegos y garantizar que las ventas no se vean desincentivadas por cambios de hardware. Al mismo tiempo, la conversación alrededor de la compatibilidad puede empujar a la industria hacia prácticas de portabilidad más consistentes y estándares de calidad que aseguren una experiencia de juego estable y satisfactoria.

Desde la perspectiva del usuario, la noticia promete menos incertidumbre al momento de adquirir una nueva consola. Saber que las inversiones en software no quedan obsoletas con el lanzamiento de una nueva generación genera confianza y puede influir en las decisiones de compra a largo plazo. En un mercado que cambia rápidamente, esa previsibilidad es un valor añadido para la base de jugadores, tanto casuales como dedicados.

Mirando hacia el futuro, la implementación de la compatibilidad descendente podría incorporar características modernas sin sacrificar la fidelidad histórica de los títulos. Es plausible esperar mejoras en la resolución, tiempos de carga y compatibilidad entre plataformas, manteniendo intacta la experiencia original cuando así lo requieran los títulos clásicos.

En resumen, el anuncio de Microsoft sobre la reintroducción del Programa de Compatibilidad Descendente para las consolas futuras marca un compromiso estratégico con la preservación del legado de sus juegos, al tiempo que responde a las expectativas de una comunidad de jugadores que valora la continuidad y la accesibilidad. Aunque los detalles exactos sobre el formato y las capacidades de la compatibilidad se comunicarán más adelante, el mensaje es claro: el pasado, presente y futuro de Xbox pueden coexistir en una experiencia unificada y atractiva para todos los jugadores.

from Latest from TechRadar https://ift.tt/irLqv2B

via IFTTT IA