En el panorama empresarial actual, muchos actores establecidos operan en un punto de inflexión estratégico. Por un lado, las compañías locales muestran una madurez operativa y una escala que les permite navegar con eficiencia en mercados complejos; por otro, se enfrentan a un entorno que cambia a una velocidad vertiginosa, impulsado por mercados emergentes que buscan ganarse espacio con modelos de negocio disruptivos.

Este choque entre madurez y agilidad crea una brecha que dificulta la competencia plena, ya que las estructuras heredadas pueden limitar la capacidad de pivotar ante nuevas oportunidades. En paralelo, las potencias tecnológicas globales —con Estados Unidos y China a la cabeza— elevan el listón de la innovación gracias a inversiones masivas en I+D, plataformas digitales y ecosistemas de cooperación que aceleran el desarrollo de productos y servicios de alta complejidad.

La disyuntiva para las organizaciones que operan en entornos locales es clara: requieren una estrategia que combine la solidez de sus procesos con una capacidad de adaptación que permita experimentar, aprender y escalar con rapidez. Esto implica, entre otros aspectos, una revisión de la gobernanza, la construcción de alianzas estratégicas y la adopción de tecnologías que reduzcan la fricción entre ideación y ejecución.

En primer lugar, es fundamental consolidar una visión clara que conecte el interés local con las dinámicas globales. Una visión que no solo identifique las áreas de excelencia, sino también las oportunidades de colaboración con actores extranjeros, instituciones académicas y startups que aporten diversidad de ideas y velocidad de ejecución.

En segundo lugar, la agilidad operativa debe convertirse en una competencia central. Esto implica simplificar procesos, desagregar funciones para permitir equipos autónomos, y establecer métricas rápidas que orienten la toma de decisiones. La reducción de capas jerárquicas y la incentivación de una cultura de experimentación pueden convertir a la empresa en un motor de innovación constante.

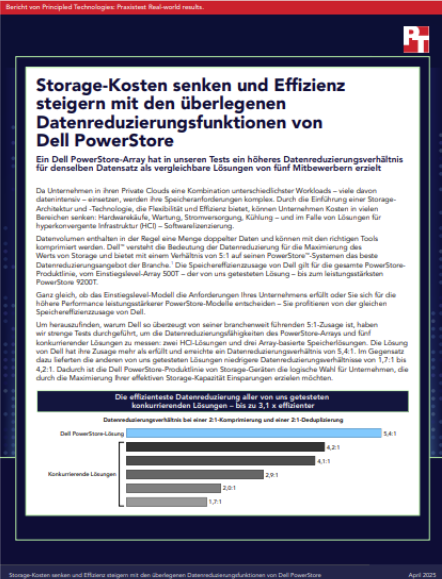

En tercer lugar, la inversión selectiva en tecnología es decisiva. No se trata de adoptar todas las tendencias, sino de identificar aquellas que tengan mayor probabilidad de impacto sostenible: automatización de procesos, analítica avanzada, plataformas en la nube y capacidades de inteligencia artificial aplicadas a áreas clave del negocio. Estas herramientas deben ir acompañadas de una estrategia de talento que fomente el aprendizaje continuo y la retención de perfiles con habilidades técnicas y estratégicas.

Por último, la cooperación internacional emerge como un habilitador crucial. Al formar alianzas con actores de mercados emergentes y con centros de innovación global, la empresa puede compartir riesgos, acelerar la validación de ideas y adaptar soluciones probadas a contextos locales. La interoperabilidad de sistemas y la gestión de datos entre fronteras requieren marcos de cumplimiento y seguridad que ofrezcan confianza a todas las partes involucradas.

En suma, las compañías situadas en economías diversas enfrentan un desafío doble: competir con mercados emergentes que buscan crecimiento rápido y, al mismo tiempo, enfrentarse a un ecosistema de innovación de alta precisión que privilegia la velocidad y la complejidad tecnológica. Solo aquellas organizaciones que integren una visión estratégica clara, una estructura operativa ágil, inversiones tecnológicas selectivas y alianzas internacionales podrán nivelar el terreno de juego y sostener un crecimiento competitivo a largo plazo.

from Latest from TechRadar https://ift.tt/cnLzd6j

via IFTTT IA