En el entorno actual de trabajo remoto y aprendizaje en casa, contar con una impresora confiable puede marcar la diferencia entre un flujo de trabajo eficiente y costos innecesarios. A continuación presento una selección de opciones, pensadas para distintos perfiles de uso en el hogar y la oficina en casa, con énfasis en costo total de propiedad, facilidad de uso y rendimiento real en tareas diarias.

Criterios de selección clave

– Costo total de propiedad (TCO): precio de compra más costo por página y frecuencia de reposición de consumibles.

– Velocidad y confiabilidad: tiempos de impresión y consistencia en volúmenes moderados a altos.

– Calidad de impresión: resolución y reproducción de colores para documentos y, si aplica, fotografías.

– Multifuncionalidad y conectividad: escaneo, copiado, fax (cuando aplica), y compatibilidad con móviles (AirPrint, Google Cloud Print, Mopria).

– Tamaño y facilidad de uso: encaje en el espacio disponible y manejo diario de consumibles.

Selección recomendada por perfiles

1) Mejor láser monocromo para hogar/oficina pequeña

– Modelo recomendado: Brother HL-L2350DW

– Por qué conviene: velocidad razonable, buen costo por página y dúplex automático; tamaño compacto y conectividad Wi‑Fi. Ideal para usuarios que imprimen principalmente documentos en blanco y negro, como facturas, apuntes y tareas escolares.

– Consideraciones: no imprime en color; si necesitas color ocasional, contempla una solución adicional de tinta o una opción láser color.

2) Mejor láser color para hogar/oficina en casa

– Modelo recomendado: HP Color LaserJet Pro M283fdw

– Por qué conviene: impresión en color con buena claridad, dúplex automático y escaneo; buena integración con redes y dispositivos móviles. Ideal para informes en color, presentaciones y documentos coloreados de trabajo o estudio.

– Consideraciones: costo de consumibles superior al láser monocromo; útiles comprarte a largo plazo si se usa con frecuencia.

3) Mejor impresora de inyección de tinta para fotos y color

– Modelo recomendado: Canon PIXMA TS9521C (o equivalente de la serie TS para uso familiar)

– Por qué conviene: calidad de color y detalla fantástica para fotos en casa, buenas opciones de conectividad y escaneo. Versátil para proyectos creativos, tareas escolares y libros de fotos.

– Consideraciones: costo de tinta más alto a largo plazo; adecuada si priorizas color y fotografía sobre costos por página.

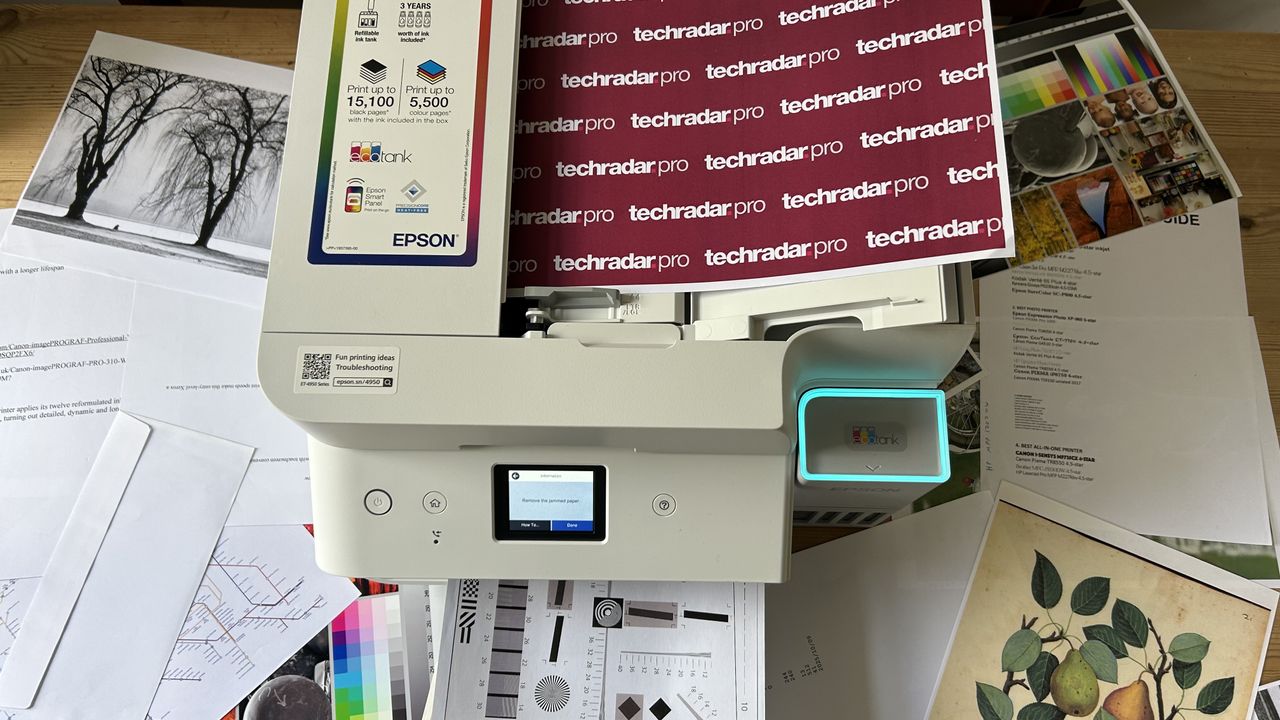

4) Mejor opción con tanque de tinta para alto volumen y bajo costo por página

– Modelo recomendado: Epson EcoTank ET-4760

– Por qué conviene: tanques de tinta recargables que reducen drásticamente el costo por página, ideal para familias o pequeños negocios con volúmenes moderados a altos. Funcionalidad multifunción (escaneo, copiado, impresión) y buena conectividad.

– Consideraciones: mayor costo inicial y tamaño físico; el ahorro llega con un uso continuo.

5) Mejor impresora todo en uno equilibrada para hogar y oficina

– Modelo recomendado: HP OfficeJet Pro 9025e

– Por qué conviene: rendimiento sólido en color y negro, buena velocidad y conectividad, seguridad y funciones para flujo de trabajo en casa (escaneo a correo, nube, impresión desde móvil). Ideal para documentos, tareas de oficina y proyectos pequeños que requieren versatilidad.

– Consideraciones: costo de tinta razonable; para grandes volúmenes de color, evaluar opciones con tanques o configuración más económica.

6) Opción de formato ancho para fotografías y proyectos creativos

– Modelo recomendado: Epson Expression Photo XP-15000

– Por qué conviene: admite impresión de fotografías en formatos de 13×19 pulgadas, buena reproducción de color y flexibilidad para crear carteles o impresiones de gran tamaño en casa. Útil para aficionados serios de la fotografía y proyectos personales.

– Consideraciones: no es la mejor opción para impresión de gran volumen de documentos de oficina; más adecuado para impresiones fotográficas y de arte.

Guía de compra rápida

– Evalúa tu carga de trabajo: ¿imprimes más texto (láser) o color y fotos (inyección de tinta)?

– Calcula el costo por página: compara los precios de tinta/tóner y el rendimiento estimado.

– Verifica la conectividad: soporte para impresión móvil, Ethernet, y puertos USB para escenarios sin PC.

– Considera el espacio: las impresoras multifunción suelen ser más grandes; verifica medidas y peso.

– Piensa en la tinta o tanque: si imprimes mucho color, un sistema con tanque de tinta puede reducir costos a largo plazo.

Conclusión

La elección ideal depende de tu balance entre costo, velocidad y calidad. Para quienes priorizan el costo por página y la impresión de volumen, las opciones con tanques de tinta y los modelos láser color son atractivas. Si el enfoque está en la calidad fotográfica y proyectos creativos en casa, las opciones de inyección de tinta con buena reproducción de color y soporte para fotografías serán más adecuadas. Considera tus necesidades reales, tu presupuesto inicial y el costo continuo de consumibles para tomar la mejor decisión para tu hogar y tu oficina en casa.

from Latest from TechRadar https://ift.tt/5MqQjwN

via IFTTT IA