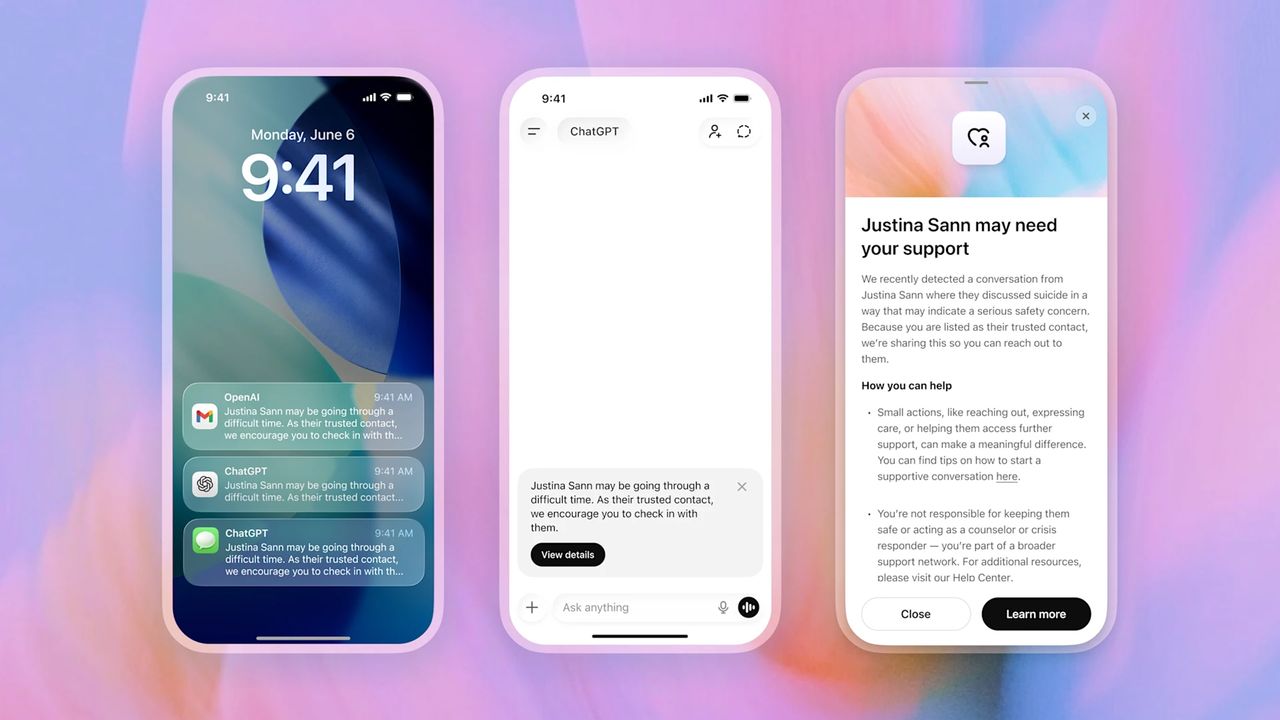

En los últimos años, la inteligencia artificial conversacional ha evolucionado para convertirse en una herramienta cotidiana en hogares, aulas y entornos laborales. Con ese crecimiento han emergido también nuevas responsabilidades en materia de seguridad y bienestar de los usuarios. En este contexto, ChatGPT ha ampliado sus sistemas de seguridad existentes al introducir una opción que permite designar a un adulto de confianza al cual se pueda contactar en situaciones de necesidad. Esta iniciativa no solo refuerza la protección de los usuarios, sino que también ofrece una ruta clara y expedita para obtener apoyo cuando la conversación requiera atención adicional.

La funcionalidad de designar a un adulto de confianza funciona como un puente entre la experiencia de la IA y la red de apoyo humana. En escenarios en los que el usuario se enfrenta a contenidos sensibles, dudas críticas o momentos de vulnerabilidad, la opción de notificar a una persona de confianza facilita una respuesta más rápida y adecuada. Este enfoque binario —IA como canal de información y un referente humano para intervención— busca equilibrar la utilidad de la tecnología con la responsabilidad social.

Entre los beneficios principales se destacan:

– Mayor seguridad emocional: al incluir a una persona de confianza, se mitiga la sensación de aislamiento y se fortalece la capacidad de respuesta ante situaciones estresantes.

– Coordinación de apoyo: el adulto designado puede ayudar a interpretar mensajes, evaluar riesgos y decidir sobre próximos pasos, manteniendo al usuario en un marco de cuidado y respeto.

– Privacidad y consentimiento: la función se implementa con salvaguardas claras para garantizar que el consentimiento del usuario sea central, respetando límites y preferencias individuales.

Es fundamental aclarar que esta característica complementa las pautas de seguridad existentes, como la escucha atenta, la promoción de prácticas seguras en línea y la escalabilidad de respuestas ante contenidos peligrosos. No sustituye la intervención de profesionales cuando la situación lo requiere, sino que actúa como una vía adicional para canalizar apoyo responsable.

Para las comunidades y organizaciones que implementan esta funcionalidad, existen consideraciones clave:

– Claridad de uso: debe explicarse de forma transparente quién puede ser designado, qué información se comparte y en qué circunstancias se activa la notificación.

– Opciones de configuración: los usuarios deben disponer de controles simples para modificar, revocar o ajustar a quién se notifica y bajo qué condiciones.

– Accesibilidad: la función debe ser fácilmente reconocible, respetuosa con la diversidad de usuarios y compatible con distintos entornos culturales y lingüísticos.

La incorporación de un adulto de confianza refuerza la idea de la IA como una herramienta segura y responsable. Al priorizar el bienestar del usuario y al mismo tiempo conservar la libertad de exploración y aprendizaje que caracteriza a estas plataformas, se crea un ecosistema donde la tecnología y el apoyo humano trabajan de la mano. En última instancia, este enfoque promueve una experiencia más consciente, confiable y humana en la interacción con la inteligencia artificial.

from Latest from TechRadar https://ift.tt/freinq3

via IFTTT IA