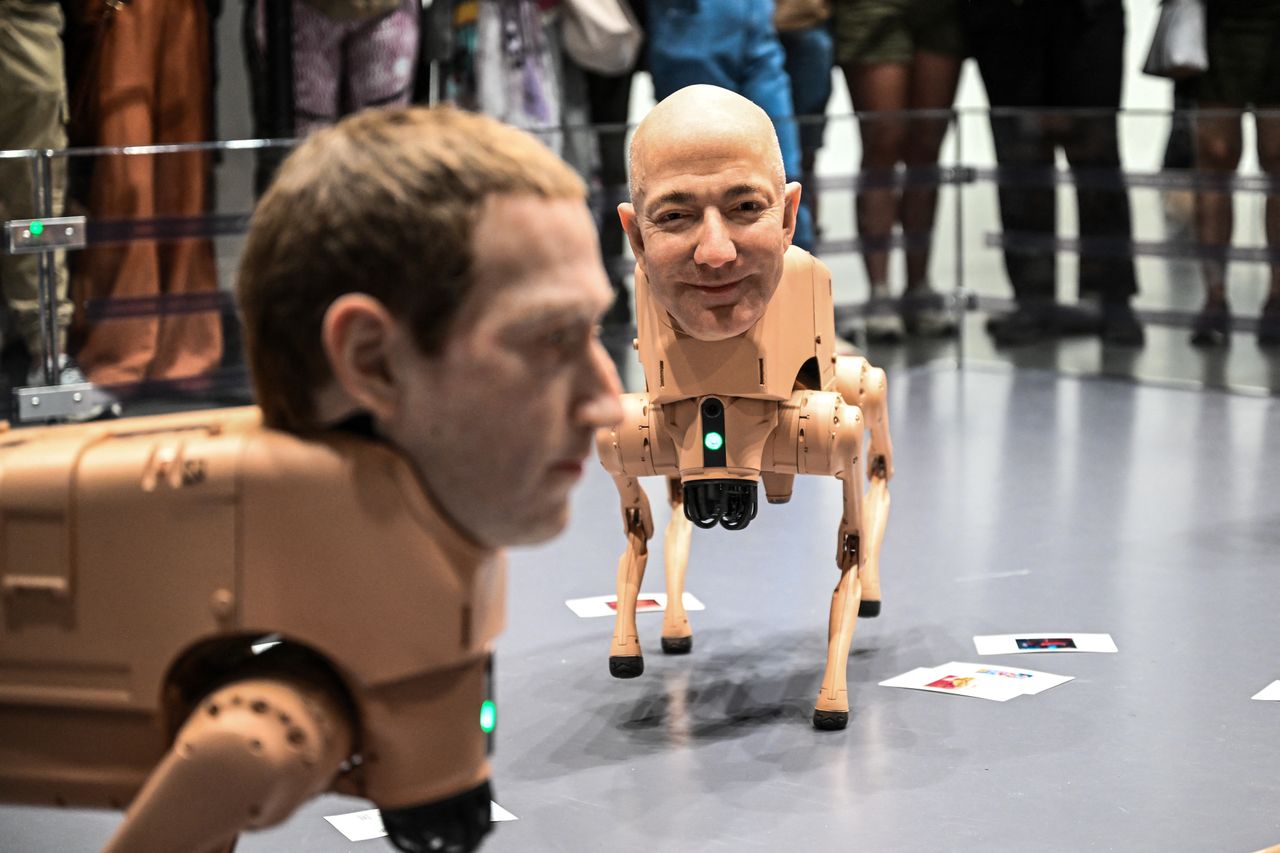

En el mundo contemporáneo, la convergencia entre robótica, IA y diseño social está redefiniendo la manera en que concebimos las interacciones con máquinas en espacios cotidianos. Este artículo explora un escenario hipotético y provocador: perros-robot equipados con rutas de comportamiento complejas y funciones de gestión de residuos, preparados para un debate profundo sobre la ética de la IA y los sesgos que pueden incrustarse en sus sistemas.

La premisa, aunque lúdica en su superficie, sirve como puerta de entrada a preguntas serias sobre responsabilidad, transparencia y gobernanza tecnológica. ¿Qué significa que una máquina tome decisiones con consecuencias para la vida humana y el entorno? ¿Cómo se manifiestan los sesgos en algoritmos que supervisan tareas cotidianas, desde la recolección de datos hasta la toma de decisiones operativas en tiempo real? Y, quizá lo más urgente, ¿cuáles son los límites y salvaguardas necesarios para evitar que sesgos invisibles se traduzcan en prácticas discriminatorias o en impactos no deseados de las políticas algorítmicas?

La ética de la IA no es un obstáculo para la innovación; es un marco que guía la responsabilidad y la confianza. En el diseño de sistemas autónomos —incluso en contextos aparentemente benignos como asistentes robóticos— conviven tres dimensiones clave: seguridad, equidad y explicabilidad. En seguridad, el objetivo es evitar fallos que comprometan la integridad física o la salud de las personas; en equidad, se busca minimizar sesgos que puedan afectar a comunidades específicas; en explicabilidad, se pretende que las decisiones algorítmicas sean razonablemente tratables y justificables ante usuarios y reguladores.

El concepto de un perro-robot que gestiona desechos y participa en discusiones sobre ética funciona como metáfora de dos dinámicas cruciales. Primero, la complejidad de los sistemas modernos que operan sin intervención humana constante exige una claridad de propósito y límites operativos explícitos. Segundo, la interacción humano-máquina en entornos civiles demanda una alfabetización tecnológica que permita a las personas comprender cuándo y cómo intervenir ante resultados no deseados.

En cuanto a sesgos, no se trata únicamente de datos de entrenamiento. Se manifiestan también en supuestos de diseño, en métricas de rendimiento y en las prioridades que guían la toma de decisiones. Por ejemplo, un protocolo de evaluación que privilegia eficiencia sobre seguridad podría favorecer ciertas conductas en detrimento de otras, influenciando percepciones de confiabilidad o legitimidad del sistema. Por ello, la evaluación responsable debe abarcar:

– Evaluación de impacto en distintos grupos demográficos y contextos de uso.

– Pruebas de robustez ante escenarios de falla y condiciones ambientales adversas.

– Transparencia en las políticas de recopilación de datos y en los criterios de decisión.

– Mecanismos de corrección rápida y supervisión humana cuando se identifiquen sesgos o daños potenciales.

La gestión de residuos en un robot con capacidades de razonamiento plantea también preguntas sobre responsabilidad ambiental. ¿Quién asume la responsabilidad por los errores de clasificación de materiales, por ejemplos de desecho inadecuado o por fallos de navegación que puedan dañar el entorno? Este aspecto subraya la necesidad de marcos legales y éticos que crucen fronteras entre desarrollo tecnológico y responsabilidad social.

Para avanzar de manera constructiva, las comunidades de desarrolladores, reguladores y usuarios deben co-crear guías de buenas prácticas que incluyan:

– Principios de diseño centrado en las personas, con énfasis en la experiencia del usuario y la accesibilidad.

– Evaluaciones de sesgo multivariantes que consideren contexto, cultura y diversidad de escenarios de uso.

– Mecanismos de auditoría independientes y verificables de algoritmos y políticas.

– Protocolos de respuesta ante incidentes y planes de mitigación de daños.

En última instancia, la discusión sobre la ética y el sesgo en IA no es una cancelación de la innovación; es una invitación a construir tecnología que sea confiable, inclusiva y responsable. Un diálogo consciente entre ingeniería y ética puede transformar escenarios complejos en oportunidades para generar beneficio real y sostenido para la sociedad. Los “perros-robot” de hoy pueden convertirse en ejemplos de cómo la tecnología puede integrarse de manera segura y transparente en la vida cotidiana, siempre que el diseño, la gobernanza y la gobernanza de datos se mantengan firmemente alineados con principios humanos fundamentales.

from Latest from TechRadar https://ift.tt/38NSnPL

via IFTTT IA