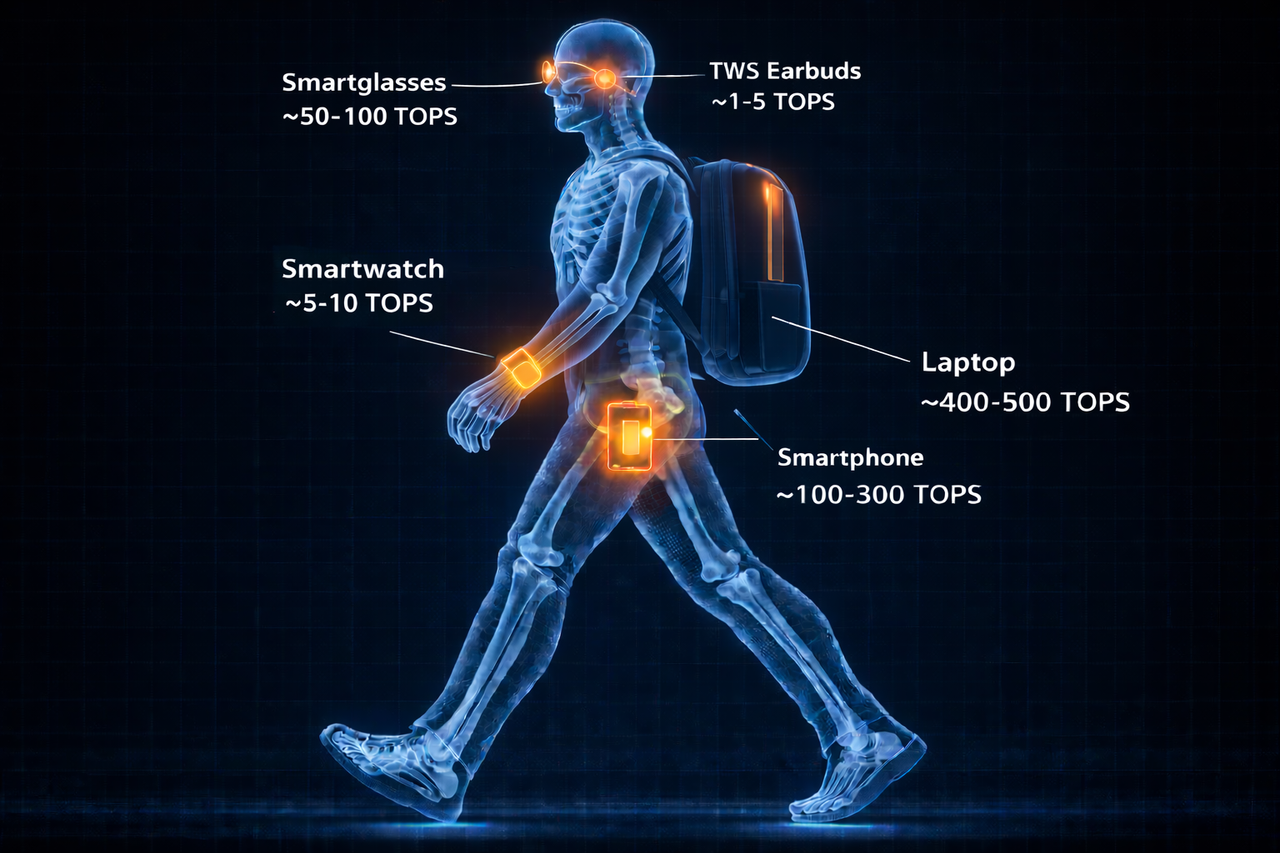

En el panorama tecnológico de 2030, la visión dominante ya no depende de un único chasis de cómputo para ejecutar IA de alto rendimiento. En su lugar, la potencia de procesamiento se reparte entre una constelación de dispositivos cercanos al usuario: smartphones, wearables, cámaras inteligentes, routers domésticos, autos conectados y electrodomésticos. Cada nodo aporta una fracción de capacidad, y, en conjunto, pueden alcanzar y superar el umbral de 1.000 TOPS por dispositivo cuando se opera como una infraestructura de inferencia distribuida. Esta transición abre la posibilidad de IA más rápida, más privada y más adaptada al contexto individual de cada usuario, sin sacrificar la experiencia ni depender de una nube externa de forma constante.

¿Qué significa exactamente 1.000 TOPS por dispositivo y por qué importa? TOPS (tera-operations por segundo) es una métrica de aumento bruto de rendimiento para tareas de IA. Contar con aproximadamente 1.000 TOPS en un dispositivo de borde implica un conjunto de capacidades que hoy están fuera de alcance para la mayoría de dispositivos móviles o domésticos. Cuando múltiples dispositivos colaboran, esa potencia se suma de manera eficiente a través de arquitecturas coordinadas: infligir menos latencia, mejorar la personalización y reducir la necesidad de enviar datos sensibles a la nube. En términos prácticos, esto permitiría ejecutar, en tiempo real, tareas complejas de visión, lenguaje y razonamiento directamente en el entorno del usuario.

Tecnologías que lo hacen factible

– Hardware de borde cada vez más capaz: unidades de procesamiento especializadas (NPU/TPU/DPU) integradas en semiconductores de consumo, con mejoras continuas en rendimiento por vatio y en eficiencia energética.

– Eficiencia y compresión de modelos: técnicas de cuantización, pruning y distilación que mantienen la precisión necesaria mientras reducen el coste computacional y la memoria requerida.

– Coordinación entre dispositivos: protocolos y runtimes que permiten orquestar inferencias y compartir estados entre nodos sin saturar la red ni exponer datos sensibles.

– Seguridad y privacidad por diseño: enfoques como inferencia distribuida segura, aprendizaje federado y esquemas de privacidad diferencial que permiten trabajar con datos locales sin desprenderse de ellos.

Arquitecturas de IA distribuida a escala de hogar y entorno

– Inferencia en cascada: un flujo donde las partes más ligeras de un modelo se ejecutan en el dispositivo local y, si es necesario, se delega a dispositivos cercanos para refinamiento, con respuestas combinadas al usuario en milisegundos.

– Inferencia distribuida: dividir una tarea entre varios nodos para aprovechar diferentes capacidades (capacidad de visión, procesamiento de lenguaje y razonamiento) y fusionar resultados de forma coherente.

– Aprendizaje y actualización federados: los dispositivos entrenan modelos localmente con datos del usuario y solo comparten actualizaciones de modelo agregadas, preservando la privacidad mientras se mejora el comportamiento global.

Casos de uso que se vuelven más viables

– Visión y realidad aumentada en casa: reconocimiento preciso de objetos y escenas, con AR que se ajusta en tiempo real a la habitación, sin depender de una nube externa.

– Asistentes de voz más contextualizados: respuestas y acciones que se adaptan al entorno inmediato del usuario, gestionadas de forma local o semi-local para reducir latencia.

– Seguridad y vigilancia inteligente: análisis continuo de flujos de vídeo en dispositivos locales para detectar eventos relevantes con rapidez y sin transferir datos personales a la nube.

– Vehículos y robótica personal: coordinación de sensores y razonamiento en dispositivos dentro de un coche o robot de servicio, logrando respuestas rápidas ante cambios del entorno.

Desafíos a resolver en la ruta hacia 2030

– Interoperabilidad y estándares: es necesario un marco común para coordinar modelos, formatos y protocolos entre fabricantes y plataformas, evitando fragmentación.

– Gestión de energía y calor: mantener consumo razonable en dispositivos móviles y domésticos mientras se mantiene el rendimiento exigido.

– Seguridad de la cadena de suministro de modelos y datos: proteger modelos, pesos y actualizaciones contra manipulación y ataques.

– Privacidad y gobernanza de datos: equilibrar la personalización con la protección de datos personales, garantizando que el procesamiento permanezca en el borde cuando sea posible.

Qué se necesita para que este escenario sea realidad para 2030

– Ecosistemas de hardware y software más abiertos: chips de IA de borde accesibles para desarrolladores y herramientas que faciliten la orquestación entre dispositivos.

– Estrategias de modelado eficiente: avances continuos en compresión, diseño de modelos ligeros y arquitecturas que favorezcan la ejecución distribuida sin perder precisión.

– Redes y conectividad confiables: infraestructuras que aseguren baja latencia y alta disponibilidad para que los dispositivos puedan coordinarse de forma fluida en tiempo real.

– Normas de seguridad y privacidad integradas: estándares que hagan factible la inferencia distribuida segura a gran escala, manteniendo la confianza de usuarios y reguladores.

Conclusión

La idea de un consumidor con 1.000 TOPS por dispositivo, respaldada por una red inteligente de nodos de borde, ya no es solo una visión de laboratorio. Es una trayectoria plausible que podría redefinir la experiencia de IA cotidiana: más personal, más rápida y más respetuosa con la privacidad. Al avanzar, el éxito dependerá de que fabricantes, desarrolladores y reguladores cooperen para construir un ecosistema donde el rendimiento de IA distribuida se aproveche al máximo, sin sacrificar la seguridad, la confianza ni la eficiencia energética.

from Latest from TechRadar https://ift.tt/jBKHhPN

via IFTTT IA