En el dinámico paisaje de la inteligencia artificial, la eficiencia de los recursos se posiciona como un factor decisivo para la adopción y escalabilidad de las tecnologías de lenguaje. Recientemente, Multiverse ha anunciado el lanzamiento de un modelo de lenguaje comprimido, desarrollado en colaboración con OpenAI, cuyo objetivo principal es reducir la memoria requerida para ejecutar modelos de gran tamaño y, a la vez, disminuir los costos asociados a la infraestructura necesaria para su despliegue.

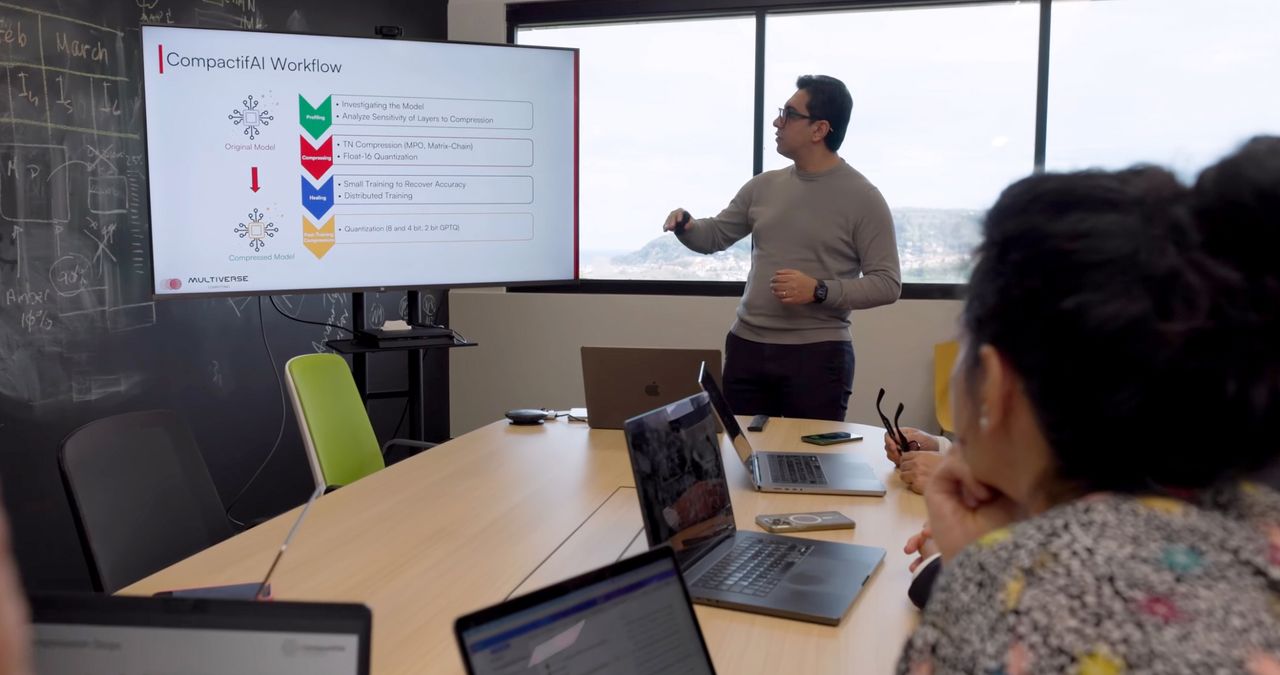

El enfoque de compresión emplea una combinación de técnicas de optimización, que pueden incluir poda estructural, cuantización avanzada y distilación de conocimiento. Estas estrategias permiten mantener un rendimiento competitivo en tareas de procesamiento del lenguaje natural (PLN) mientras se reducen los requisitos de memoria. En términos prácticos, esto se traduce en modelos más pequeños que requieren menos VRAM y RAM durante la inferencia, lo que posibilita operaciones más eficientes en centros de datos con recursos limitados y abre la puerta a despliegues en dispositivos con capacidades reducidas, como servidores con presupuestos ajustados o soluciones en la nube de menor costo.

Un beneficio clave de estas reducciones es la posibilidad de ampliar la cobertura de casos de uso sin sacrificar la calidad de las respuestas. Al optimizar la arquitectura y la representación de conocimiento, el modelo comprimido puede mantener coherencia, precisión y fluidez en la generación de texto, respuestas a consultas y tareas de PLN complejas, como razonamiento, traducción y interpretación de contexto. Además, la menor demanda de memoria puede traducirse en menores costos de licenciamiento, mantenimiento y escalamiento horizontal, impactando positivamente tanto a grandes organizaciones como a startups que buscan acelerar su innovación sin comprometer la viabilidad financiera.

La noticia subraya una tendencia más amplia en la industria: la búsqueda de soluciones eficientes que no comprometan el rendimiento. A medida que los modelos de lenguaje crecen en capacidad, también lo hacen sus requerimientos computacionales. Las iniciativas de compresión y optimización permiten liberar recursos para otras funciones críticas, como la moderación de contenido, la personalización responsable y la seguridad de datos, al tiempo que ofrecen una experiencia de usuario más ágil y receptiva.

De cara al futuro, el lanzamiento de estos modelos comprimidos invita a la comunidad a reconsiderar la métrica de éxito para los sistemas de PLN. Más allá del tamaño o la velocidad bruta, la resiliencia, la fiabilidad y la sostenibilidad de la infraestructura emergen como indicadores prioritarios. En ese contexto, múltiples actores de la industria están explorando rutas para estandarizar prácticas de evaluación de compresión, compartir benchmarks y promover interoperabilidad entre plataformas para facilitar la adopción generalizada de soluciones de IA eficientes.

En definitiva, la propuesta de Multiverse representa un paso significativo hacia la democratización de la IA avanzada: modelos potentes que exigen menos memoria y consumen menos recursos, sin perder la capacidad de generar valor real para negocios, investigadores y usuarios finales.

from Latest from TechRadar https://ift.tt/EWyK3dS

via IFTTT IA