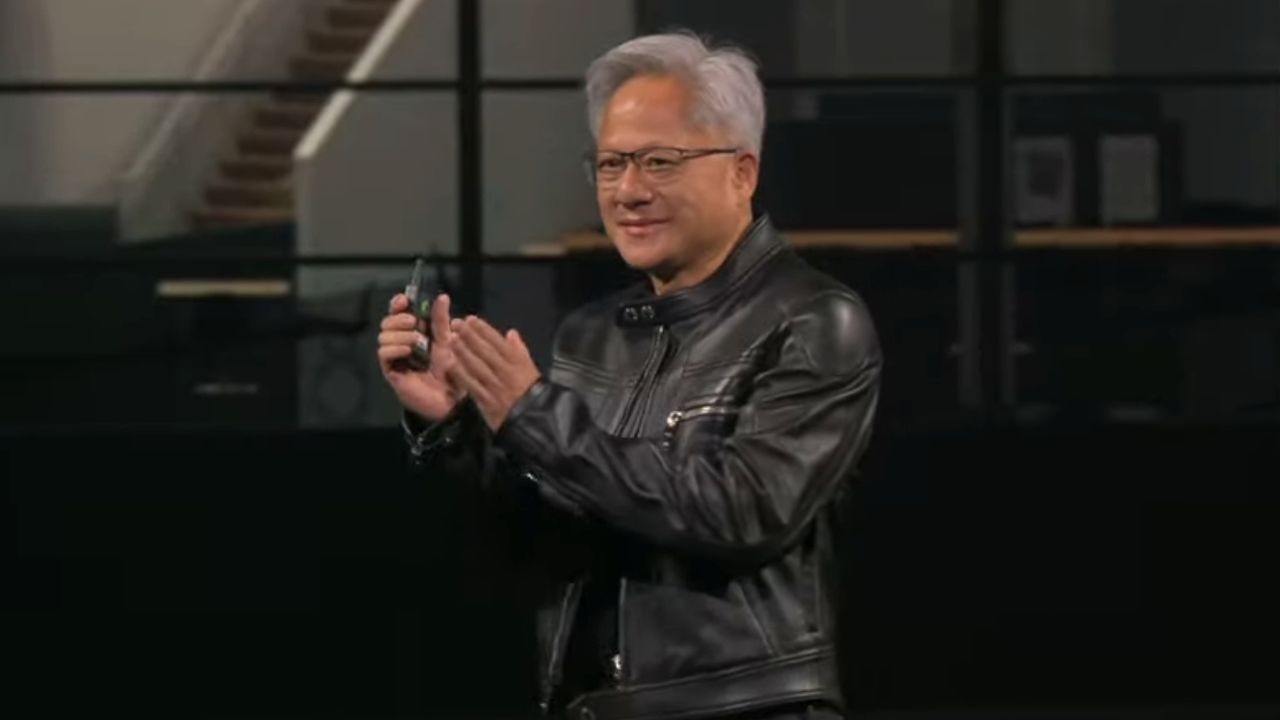

En un momento clave para la industria tecnológica, el CEO de Nvidia, Jensen Huang, ha planteado una inquietud que merece nuestra atención: el peligro del llamado ‘doomerismo’ en torno a la inteligencia artificial. Su mensaje resuena en un entorno donde los avances en IA prometen beneficios sustantivos, pero también generan preocupaciones reales sobre seguridad, optimización de recursos y impactos sociales. Este ensayo explora las ideas centrales de Huang y las implicancias para empresas, investigadores y responsables de políticas públicas.

1. El contexto actual de la IA

La IA ha evolucionado de forma acelerada, impulsada por avances en aprendizaje profundo, hardware más potente y grandes conjuntos de datos. Esta combinación ha permitido mejoras notables en áreas como reconocimiento de voz, visión por computadora, generación de contenidos y sistemas de recomendación. Sin embargo, con cada incremento de capacidad llegan también preguntas sobre control, sesgos, transparencia y posibles usos indebidos. Huang insiste en que la narrativa de catástrofe no debe ser la única que guié el rumbo de la investigación y la adopción de tecnologías IA.

2. El peligro del ‘doomerismo’

El término describe una visión extremadamente pesimista que predice colapsos, caídas de empleo masivas o descontrol irremediable de sistemas autónomos. Si bien es razonable anticipar riesgos, un activismo centrado solo en la alarma puede tener efectos contraproducentes: frena la innovación responsable, desinforma a la sociedad y politiza decisiones técnicas que requieren análisis técnico riguroso. Huang propone un enfoque equilibrado: reconocer riesgos reales sin convertir la IA en un chivo expiatorio para problemas estructurales que requieren respuestas multidisciplinarias.

3. Riesgos reconocidos y respuestas proactivas

Entre los riesgos que suelen preocupar a la industria y a la academia se encuentran: la seguridad operativa de sistemas autónomos, la posibilidad de sesgos en modelos entrenados con datos no representativos, la gestión de impactos laborales y la necesidad de estructuras de gobernanza que aseguren responsabilidad y trazabilidad. Las respuestas no son simples ni únicas: requieren normas claras, estándares de seguridad, auditorías independientes y una colaboración estrecha entre desarrolladores, reguladores y la sociedad civil. Huang sugiere que la innovación puede y debe ir acompañada de salvaguardas que permitan escalar soluciones de manera segura.

4. Un marco para avanzar con cautela y audacia

Para avanzar de forma responsable, se proponen varios pilares:

– Transparencia y comprensión: comunicarse con claridad sobre capacidades y limitaciones de los sistemas de IA.

– Gobernanza y responsabilidad: establecer responsables de resultados y mecanismos de rendición de cuentas.

– Seguridad y resiliencia: diseñar para detectar fallos, mitigar daños y evitar efectos adversos no deseados.

– Inclusión y equidad: trabajar para reducir sesgos y asegurar que los beneficios de la IA lleguen a comunidades diversas.

– Colaboración público-privada: fomentar marcos regulatorios que acompañen la innovación sin sofocarla.

5. Implicaciones para líderes y empresas

Los ejecutivos deben mirar más allá de las métricas de corto plazo y considerar escenarios futuros en los que la IA redefine procesos, productos y estructuras organizativas. Esto implica inversión en talento, cultura de seguridad y alianzas con instituciones de investigación. La visión de Huang sugiere que el éxito no se mide solo por la rapidez de despliegue, sino por la capacidad de gestionar riesgos de forma proactiva y sostenible.

6. Conclusión

El debate sobre la inteligencia artificial no debe encauzarse hacia el miedo o la complacencia. Es necesario un marco equilibrado que permita aprovechar el potencial de la IA, al tiempo que se reconocen y mitigan sus riesgos. Jensen Huang propone precisamente eso: una conversación responsable, informada y orientada a construir un futuro en el que la tecnología sea una aliada para la sociedad, no un motivo de alarma constante. Si logramos combinar audacia con prudencia, podemos avanzar hacia innovaciones que beneficien a todos, sin caer en visiones extremas que paren el avance científico y tecnológico.

from Latest from TechRadar https://ift.tt/fY2C01B

via IFTTT IA