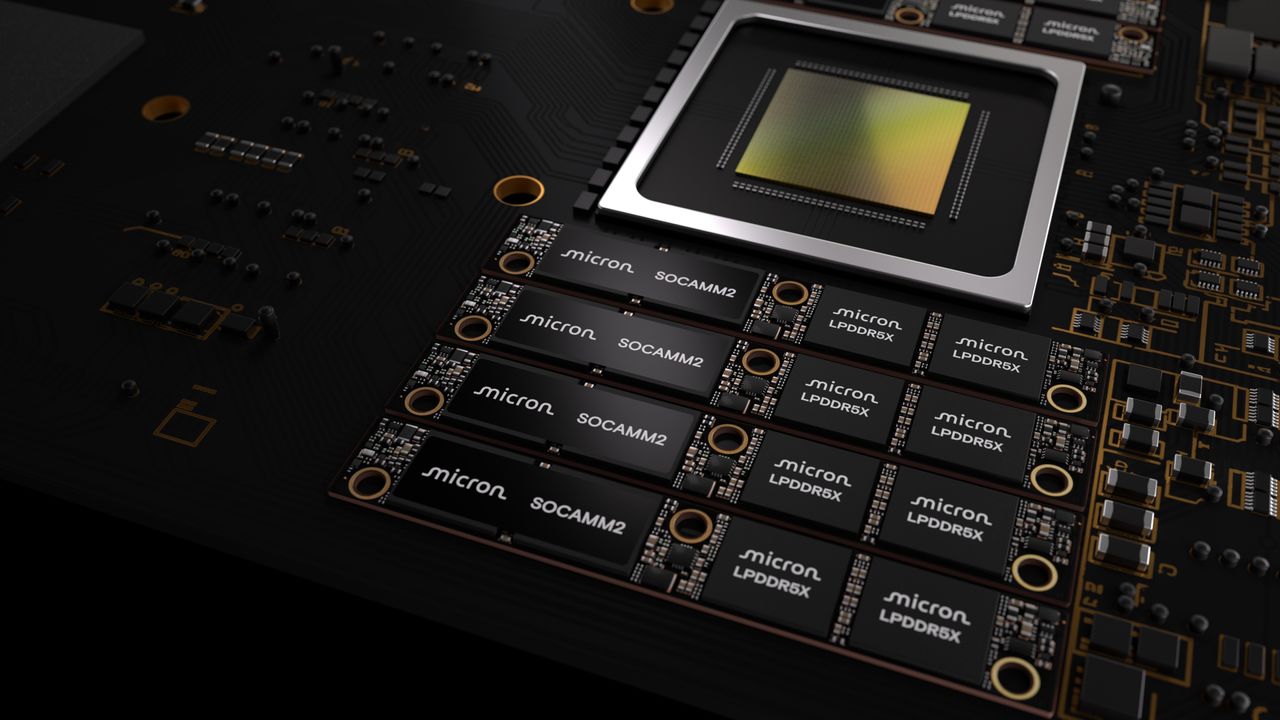

En el dinámico paisaje de los servidores destinados a inteligencia artificial, la eficiencia y la capacidad de memoria son factores críticos que definen el rendimiento y la escalabilidad. Micron ha dado un paso contundente al presentar un módulo de memoria SOCAMM2 de 256GB basado en LPDDR5x, diseñado específicamente para entornos de servidor donde las cargas de trabajo de IA exigen tanto ancho de banda como densidad de datos.

El nuevo módulo de 256GB se enmarca en una arquitectura optimizada para IA, permitiendo configuraciones que pueden escalar hasta 2TB en sistemas compatibles. Esta capacidad ampliada se traduce en ventajas concretas para modelos de aprendizaje profundo, procesamiento de datos en tiempo real y escenarios de inferencia que requieren acceso rápido a grandes volúmenes de memoria. Además, la implementación LPDDR5x aporta mejoras en la velocidad de transferencia y en la eficiencia energética, lo que resulta en un consumo reducido frente a soluciones de memoria de mayor capacidad en generaciones anteriores.

Entre los beneficios técnicos destacan:

– Mayor densidad por DIMM, facilitando configuraciones multi-mocket y mayor holgura para modelos complejos.

– Ancho de banda suficiente para alimentar redes neuronales profundas sin cuellos de botella en la memoria.

– Optimización de consumo energético, un factor crucial en centros de datos donde la eficiencia operativa impacta directamente en los costos y la sostenibilidad.

– Compatibilidad con plataformas de servidor modernas que buscan equilibrar rendimiento, densidad y eficiencia para cargas de IA contemporáneas.

La adopción de este módulo de 256GB LPDDR5x no solo responde a las necesidades actuales de IA, sino que también sienta las bases para futuras ampliaciones. Los sistemas que integren estas unidades podrán escalar su capacidad de memoria hasta 2TB con una huella de potencia más contenida, lo que facilita la implementación de modelos más grandes y pipelines de procesamiento más complejos sin comprometer la eficiencia energética.

En un mercado donde la demanda de rendimiento de IA continúa creciendo, soluciones como la nueva memoria SOCAMM2 de Micron refuerzan la disponibilidad de hardware capaz de sostener cargas de trabajo exigentes, manteniendo una relación favorable entre costo, rendimiento y consumo. Las redes de centros de datos, laboratorios de investigación y proveedores de servicios en la nube pueden anticipar mejoras significativas en la velocidad de entrenamiento y en la eficiencia operativa al incorporar estas soluciones de memoria avanzadas en sus arquitecturas.

from Latest from TechRadar https://ift.tt/v5OfL3x

via IFTTT IA