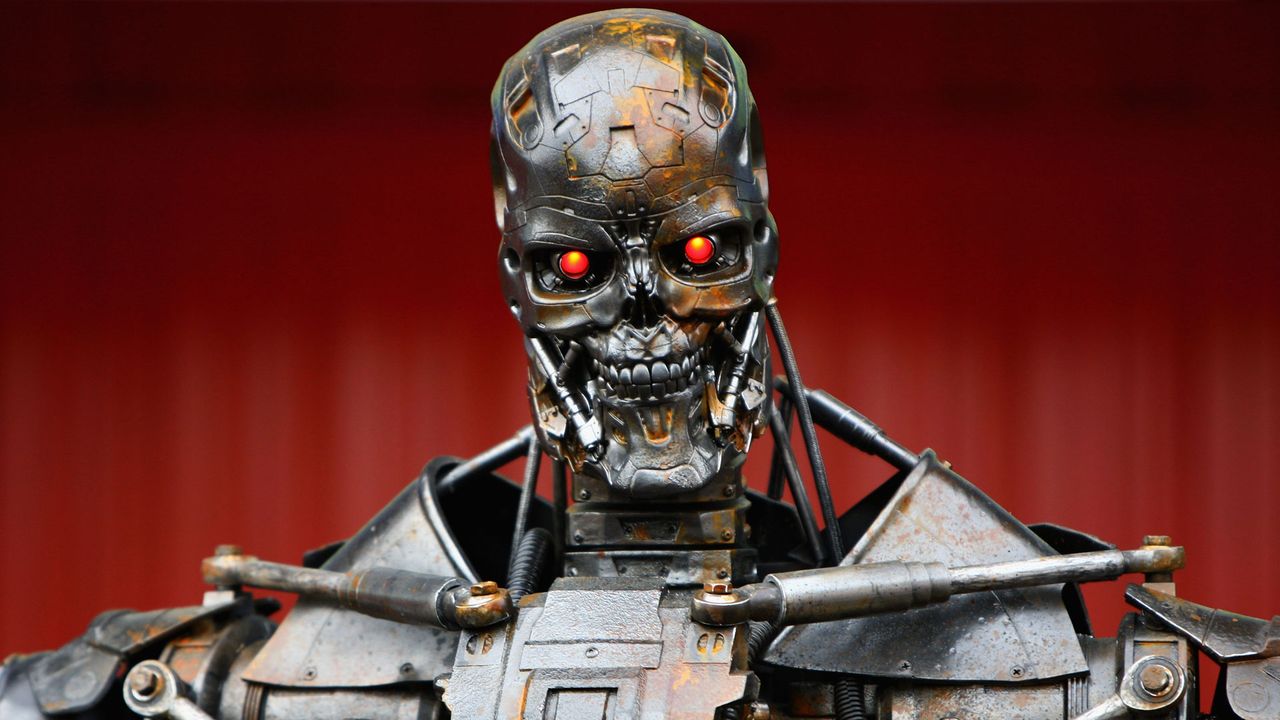

En un momento en que la inteligencia artificial (IA) avanza a pasos acelerados, la ética y la responsabilidad se han convertido en temas centrales para las comunidades tecnológicas y la sociedad en general. Un grupo significativo de empleados de Google y OpenAI ha decidido alzar la voz para pedir a sus empresas un compromiso público y claro: establecer límites firmes sobre el uso de la IA con fines militares. Este gesto no solo refleja una preocupación por las implicaciones éticas, sino que también subraya la necesidad de marcos institucionales robustos que prevengan abusos y garanticen rendición de cuentas.

El debate sobre la militarización de la IA abarca múltiples dimensiones. Por un lado, existe el potencial de reducir riesgos humanos en escenarios de conflicto extremo, como tareas de reconocimiento, logística y vigilancia. Por otro, persisten temores legítimos acerca de la deshumanización de la guerra, la posibilidad de errores catastróficos, la escalada de conflictos y la erosión de normas internacionales que protegen a civiles.

La carta firmada por empleados de dos de las compañías más influyentes del ecosistema tecnológico sirve como un recordatorio de que la innovación no sucede en un vacío. Las organizaciones que desarrollan y gestionan tecnologías de IA están, de facto, participando en una conversación global sobre límites, controles y gobernanza. En este marco, la claridad en las políticas internas y la transparencia frente a las prácticas externas se convierten en herramientas esenciales para ganar confianza pública y fomentar un progreso responsable.

Entre las preguntas clave que deberían guiar estas discusiones se encuentran: ¿Qué usos se consideran aceptables y cuáles son tajantemente inaceptables? ¿Qué salvaguardas técnicas y legales deben implementarse para evitar fallos catastróficos o usos indebidos? ¿Cómo pueden establecerse mecanismos de supervisión externa, auditoría y responsabilidad? ¿Qué papel deben desempeñar los gobiernos, las organizaciones internacionales y la sociedad civil en la definición de normas compartidas?

Más allá de las consideraciones éticas, este movimiento subraya la urgencia de construir marcos de gobernanza que acompañen la innovación tecnológica. La certidumbre regulatoria y la coherencia en las políticas internas no obstaculizan la creatividad; la orientan hacia fines que minimicen daños y protejan derechos humanos fundamentales. Una postura proactiva de las empresas tecnológicas para delinear límites claros puede evitar escaladas no deseadas, reducir la probabilidad de uso indebido y fortalecer la legitimidad de las inversiones en investigación.

En última instancia, la responsabilidad recae tanto en las compañías como en la comunidad global que observa, evalúa y, cuando corresponde, exige rendición de cuentas. El llamado de estos empleados es un recordatorio de que la ética no es una opción adicional, sino una base operativa para una innovación durable. Si las empresas pueden consolidar políticas públicas coherentes y transparentes, existe una oportunidad tangible de avanzar en capacidades tecnológicas sin sacrificar principios fundamentales.

Este momento invita a un diálogo informado y constructivo: organizaciones, reguladores, académicos y sociedad civil deben colaborar para delinear límites, garantizar transparencia y promover un uso de la IA que fortalezca la seguridad, la dignidad humana y la paz mundial.

from Latest from TechRadar https://ift.tt/Gsroul8

via IFTTT IA